平衡AI發展優劣勢 歐盟發布人工智慧法律調和規則草案

(中央社訊息服務20210922 17:00:41)

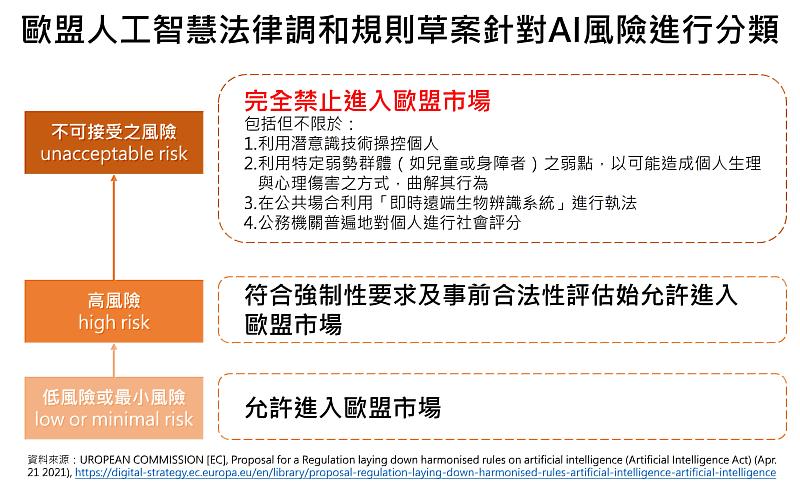

歐盟發布草案,希望促使會員國面對AI發展與應用時,能採取一致性作法。例如針對AI風險進行分類,以決定是否允許進入歐盟市場。

歐盟執委會為平衡人工智慧(AI)運用所帶來的優勢與對個人或社會可能產生的潛在衝擊, 於今(2021)年4月發布《人工智慧法律調和規則草案》(Proposal for a Regulation Laying Down Harmonised Rules on Artificial Intelligence (Artificial Intelligence Act) and Amending Certain Union Legislative Acts),希望藉由明確的法規範,有效落實AI治理,促使會員國在發展及運用AI時,能採取協調一致的態度及方法,共同維護歐洲公民基本權利與歐盟價值。

財團法人資訊工業策進會科技法律研究所(資策會科法所)法律研究員許嘉芳表示,雖然草案目前尚在審議階段,預計2024年下半年相關標準規範才會完備並完成初次的符合性評估,但仍由此看出歐盟快速的發展速度,已從「指導性原則或指引」朝向「一致的規則」發展,逐漸由自律走向他律。

|

|

許嘉芳也指出,目前國際間針對AI倫理及法制議題的討論雖未有定論,但有鑒於AI發展及其影響的重要性,應釐清AI應用所生之決策對基本人權、個人隱私保護及資料自主決定帶來疑慮與風險。許嘉芳提醒,因AI倫理議題與個人或弱勢群體的權益息息相關,應注意民主自由國家或國際組織發展趨勢,以便作為我國未來推動AI倫理法制規劃之參考。希望藉由接軌國際潮流,從而增加我國參與AI相關重要國際組織或會議之機會。 AI相關技術快速進步,開發及應用更橫跨多數產業與社會活動,且有助於提升國家競爭優勢,各國紛紛將AI發展納入國家重大政策。而我國自2017年宣示為AI元年後,於同年8月推出「AI科研戰略」,並於2018年1月起推動為期四年之「台灣AI行動計畫」,科技部更於2019年2月所提出《人工智慧科研發展指引》。目前我國AI法制倫理相關政策規劃,仍屬於上位指導原則而不具強制力,許嘉芳建議未來應參考外國經驗並找出AI倫理規範之共通點,建立負責任或可信賴的AI規範,以界定政府機關使用AI產品或服務之要求,並鼓勵企業組織從設計階段納入AI倫理做起。 |