日本《人工智慧技術研究開發及應用促進法》簡介

日本《人工智慧技術研究開發及應用促進法》簡介

資訊工業策進會科技法律研究所

2025年06月25日

為全面性且有計畫地推動人工智慧(以下簡稱AI)相關技術之研發及應用,同時為改善國民生活和促進國家經濟健康發展做出貢獻,日本內閣於2025年2月28日提出《人工智慧技術研究開發及應用促進法》(以下簡稱本法)草案。 [1]

本法進一步於同年5月28日經參議院表決通過[2] ,通過之條文內容與2月28日提出之草案並無二致,惟5月27日內閣委員會另外通過20點附帶決議[3] ,其中涵蓋共多具體措施。本法於6月4日公布施行[4] ,以下將介紹本次日本《人工智慧技術研究開發及應用促進法》及附帶決議內容。

壹、立法緣由

近年AI技術及應用蓬勃發展,然而日本卻深感國內對AI發展不如其他主要國家,依據科學技術創新推進事務局(科学技術・イノベーション推進事務局,以下簡稱科技事務局)釋出之立法概要,本次立法主要有兩大理由 [5]:

一、國內AI技術開發、應用起步緩慢

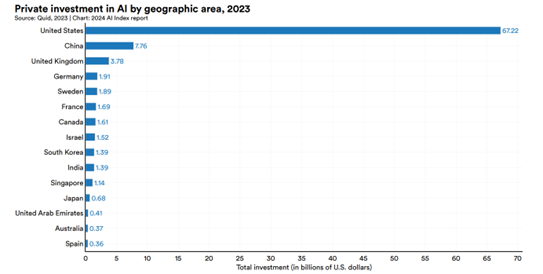

科技事務局引用史丹佛大學於2024年所發布之《AI指數報告》(AI Index Report 2024),該份報告彙整2023年各國對於AI相關產業之民間投資額,如下圖所示。從此圖可知,作為世界主要經濟體的日本,對於AI的民間投資於2023年竟僅有6.8億美元,遠遠不及美國的670.22億美元、中國77.6億美元及英國37.8億美元。[6]

圖一、各國對於AI相關產業民間投資額統計

資料來源:STANFORD INSTITUTE FOR HUMAN-CENTERED AI [HAI], Artificial Intelligence Index Report (2024).

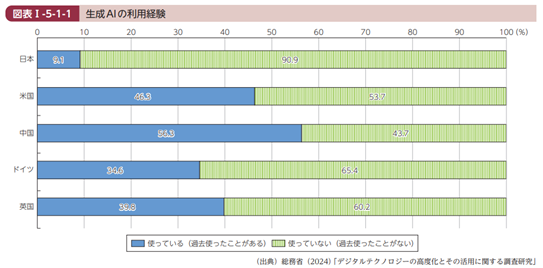

此外,根據日本總務省於2024年所發布之調查結果,如下圖所示,日本僅有9.1%的國民有使用過生成式AI之經驗,相較於中國的56.3%、美國的46.3%、英國的39.8%及德國的34.6%,仍有相當程度之落後。 [7]

圖二、各國國民使用過生成式AI之經驗調查

資料來源:総務省,令和6年版情報通信白書

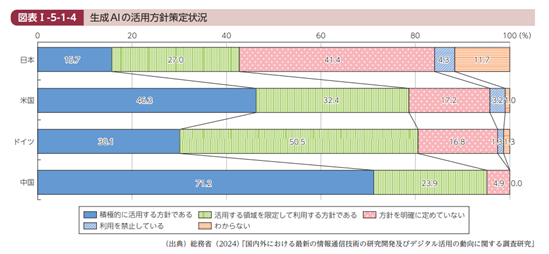

不僅國民的AI使用率低,日本總務省亦針對企業將AI運用於其業務進行調查,如下圖所示,目前有在使用AI之企業僅有46.8%(包含已取得具體成效及尚未取得成效),其餘53.2%之企業則正在測試階段、正在商議導入或至今仍未討論導入。對比中國的95.1%、德國的80.6%及美國的78.7%,雖不如國民使用率落後,但仍有不少進步空間。[8]

圖三、各國企業業務中AI運用情形調查

資料來源:総務省,令和6年版情報通信白書

二、多數國民對於AI仍感到不安

科技事務局引用KPMG於2023年所發布的《全球AI信任研究報告》(Trust in AI: A Global Study 2023),僅有13%的日本國民認為現行法規已足以確保AI可被安全使用,亦低於中國的74%、德國的39%及美國的30%。此調查結果亦如實反映出有77%的日本國民迫切希望國內能針對AI訂定相關規範。[9]

除上述兩項主要理由外,考量日本有需要進一步促進創新發展、積極應對AI產生之風險,因此科技事務局決定訂立新的AI法規。

貳、立法重點

《人工智慧技術研究開發及應用促進法》總計28條,共分為四個章節,包含第一章總則(第1條至第10條)、第二章基本政策實施(第11條至第17條)、第三章人工智慧基本計畫(第18條)及第四章人工智慧戰略本部(第19條至第28條)。考量依法規條文及章節順序不易說明,以下將以科技事務局所提供之立法概要之脈絡進行說明。

一、目的

第1條即說明本法旨在全面且有計畫地制定AI相關政策,推動AI技術之研發與應用,以改善國民生活並為國民經濟發展做出貢獻。

二、基本理念

第3條亦規定AI技術之研發與應用應以提升AI產業之國際競爭力為目標,希冀藉由AI技術創造高效率新業務,並得以應用於國民日常生活與經濟活動之各階段,另考量AI技術若經不當使用,將有助漲犯罪行為或洩漏個資等風險發生之可能性,故應確保AI技術之正確使用。最後,同條亦規定日本應在AI技術之研發與應用上進行國際合作,並努力在國際合作中取得主導地位。

三、AI戰略本部

本法第四章皆為設立AI戰略本部相關之條文,第19條、第20條及第25條第2項規定AI戰略本部應由內閣所設立,其職責有以下兩項:

(一)研擬AI基本計畫草案,並推動相關事宜。

(二)促進AI相關技術研發及應用相關重要政策之規劃、提案及統籌協調等事宜。

(三)除本法規定的事項外,總部相關必要事項由政令規定。

為使AI戰略本部可順利履行上述職責,第25條賦予AI戰略本部認為有必要時,得向行政機關、地方公共團體、獨立行政機構、地方獨立行政機構的首長以及公共機關的代表,要求提供資料、發表意見、進行說明及提供其他必要協助。

第21條至第28條則為與本部組成相關之規定,其規定AI戰略本部組成成員包含以下三個職位:

(一)部長:由總理擔任,掌管總部事務,並領導監督總部工作人員。

(二)次長:由官房長官及AI戰略大臣(由總理任命)擔任,負責協助部長履行職責。

(三)由除部長、次長以外的所有國務大臣組成。

四、AI基本計畫

如上所述,AI戰略本部重要職責之一,即研擬AI基本計畫草案。依第18條規定,總理應將AI戰略本部所研擬之AI基本計畫草案,提請內閣決定是否同意草案內容,待內閣作成決定後,總理應立即公布AI基本計畫。

同條亦明定AI戰略本部應以前述第二節的基本理念及以下第五節的基本政策實施之相關規定為基礎,研擬AI基本計畫草案,其應涵蓋之事項包含:

(一)AI技術研發及應用政策實施的基本方針。

(二)為促進AI技術研發及應用,政府應全面性且有計畫地實施政策。

(三)政府為能全面性且有計畫地實施政策所採取的必要措施。

五、基本政策實施

第二章所涵蓋之第11條至第17條則規定政府應執行之基本政策實施事項,包含:

(一)促進AI技術研發

依第11條規定,國家應採取措施促進AI技術研發,使AI技術可順利從基礎研究階段進展至實際應用階段,並在研發機構間建立研發成果得以互相流通之制度,同時提供研發成果資訊。

(二)提升基礎設施建置與使用

依第12條規定,國家應採取措施建置AI基礎設施,包含AI技術研發及應用所需之大規模資料處理、資通訊、電磁紀錄儲存等設備及為特定目的所收集之資料集等,並使AI基礎設施得以廣泛供研發機構或企業所使用。

(三)確保符合國際規範

依第13條規定,國家應根據國際規範制定基本方針並採取其他必要措施,以確保AI技術之研發及應用得以適當之方式進行。

(四)確保人力資源

依第14條規定,國家應與地方政府、研發機構和企業緊密合作,並採取必要措施,以確保、培訓和提升各領域人才的專業素質,使其具備AI技術從基礎研究至實際應用於民眾生活或經濟活動之各階段所需之專業知識,並提升其專業知識之廣度及深度。

(五)提升教育

依第15條規定,國家應提升與AI技術相關之教育與學習、辦理推廣活動或採取其他必要措施,以增進大眾對AI技術之認知與興趣。

(六)研究調查

依第16條規定,國家應掌握國內外AI技術研發及應用之最新趨勢,並進行有助於AI技術研發及應用發展之研究與調查,包含分析因不正當目的或不適當方法研發應用所導致國民受侵害之案例,及針對不正當使用之因應對策。

同時,國家亦應根據此類研究調查成果,向研發機構、企業和其他人員提供指導、建議和最新資訊,並採取其他必要措施。

(七)國際合作

依第17條規定,國家應進行AI技術研發及應用之國際合作,積極參與國際規範之制定過程。

六、職責

第4條至第8條分別規定國家、地方政府、研發機構、企業與國民應各司其職,其職責分述如下:

(一)國家

依第4條規定,國家應依前述第二節的基本理念,制定並實施促進AI技術研發及應用之基本政策實施相關之計畫。此外,國家應在行政機關間積極應用AI技術,以提升行政效率。

(二)地方政府

依第5條規定,地方政府應依前述第二節的基本理念,在與國家進行適當分工後,結合各地方特色,制定並實施自主政策,以促進AI技術之研發及應用。

(三)研發機構

依第6條規定,大學及研發機構應依前述第二節的基本理念,積極進行AI技術之研發,推廣其成果,培育具有專業性和廣泛知識之人才,並協助國家與地方政府之政策實施,而國家與地方政府則應促進大學研究活動,尊重研究人員自主權及將各大學之特色納入考量。

此外,研發機構應進行跨領域或綜合性研發,同時為有效推動AI技術研發,應綜合考量人文科學及自然科學等領域之專業知識。

(四)企業

依第7條規定,任何企業有意開發或提供使用AI技術之產品或服務,或任何其他有意在其業務活動中使用AI技術,應依前述第二節的基本理念,提升其業務之效率和品質。

此外,上述企業應透過積極使用AI技術創造新興產業,並須配合執行國家依第4條所定之措施及地方政府依第5條所定之措施。

(五)國民

國民應依前述第二節的基本理念,加深對AI技術之認知與興趣,並盡可能配合執行國家依第4條所定之措施及地方政府依第5條所定之措施。

七、附帶決議

本次立法過程除條文本身外,5月27日內閣委員會亦通過20點附帶決議,針對政府實施本法時應採取之適當措施進行補充說明,以下摘錄重點說明 :[10]

(一)政府應以「以人為本之AI社會原則」為基礎,進行AI技術研發及應用。

(二)政府制定AI基本計畫和基本方針,或執行政策措施時,應將風險降至最低,並考量推廣AI之益處。

(三)企業和國民應充分了解AI應用之注意事項及規避風險之措施,並透過教育使國民了解AI合理使用方法及其風險。

(四)政府針對AI應用導致之失業或貧富差距擴大採取必要措施。

(五)政府應透過法規打擊AI技術之濫用,特別是利用兒童圖像產生之深偽色情內容,並加強對網站管理員刪除違法內容之監管,保護受害者。

(六)政府和民間機構將合作開發以日語為基礎之大型語言模型。

(七)政府應消除新創企業等新進者之壁壘,創造公平開放之市場環境。

(八)政府應將AI定位為國家戰略重要領域。

(九)政府應考慮電力供需,策略性地建設資料中心。

(十)政府應以跨學科之觀點強化對AI人才之培養,並確保足夠有投資。

(十一)政府應積極營造有利於國家、地方政府、企業應用AI之環境,並避免因營運效率提升而出現裁員情形。

(十二)政府應執行降低AI風險之措施,並進行公私合作以確保安全。

(十三)政府於進行調查和指導時,應避免施加過重之負擔或要求過多資訊揭露,同時考慮保護企業之商業機密等智慧財產權。

(十四)政府於國民權益受害之個案進行調查和指導時,應即時自企業或服務使用者和人工取得資訊,以便迅速發現個案並因應。

(十五)針對依《廣島人工智慧進程國際行為準則》負有報告義務之企業,政府應最大限度地減少其與現行國內法規之報告義務之重複。

(十六)政府應不斷修訂本法及其他相關計畫與方針,以確保AI應用能促進國民生活改善和國民經濟發展,並及時應對新風險。

(十七)AI戰略總部之組織架構,應消除各部會、機構垂直分工造成之弊端,並積極自民間招募人才。

(十八)政府應儘早成立由AI倫理、法律和社會議題等領域專家組成的智庫機構。

(十九)如出現現行法規難以因應之新風險,政府應考慮導入風險導向之概念,依風險等級而採取不同監管措施。

(二十)因應AI應用產生之智慧財產權相關侵權行為,政府應參考其他國家之情形,探討因應措施。

參、總結

日本緊接著韓國之後,成為亞洲第二個在法律層級通過AI法規的國家,惟相較歐盟或韓國通過的AI法,日本在法律條文的訂定上,主要是針對政府與各界之職責進行規範,而缺乏對於AI技術開發或應用風險之監管。儘管附帶決議中較多具體內容,仍須待AI基本計畫訂定後,日本對於AI技術開發或應用之監管模式才會有較清晰之雛形。

考量到日本尚有通過20點附帶決議,日後仍可關注AI戰略本部如何依據AI法及附帶決議擬定AI基本計畫,未來或可成為我國人工智慧法制政策規劃之參考依據。

[1]人工知能関連技術の研究開発及び活用の推進に関する法律案(第217回閣法第29号)。

[2]〈議案情報:人工知能関連技術の研究開発及び活用の推進に関する法律案〉,参議院,https://www.sangiin.go.jp/japanese/joho1/kousei/gian/217/meisai/m217080217029.htm(最後瀏覽日:2025年6月11日)。

[3]参議院,〈人工知能関連技術の研究開発及び活用の推進に関する法律案に対する附帯決議〉,https://www.sangiin.go.jp/japanese/gianjoho/ketsugi/current/f063_052701.pdf(最後瀏覽日:2025年6月11日)。

[4]人工知能関連技術の研究開発及び活用の推進に関する法律法律(令和7年法律第53号)。

[5]內閣府,〈人工知能関連技術の研究開発及び活用の推進に関する法律案(AI法案)概要〉,https://www.cao.go.jp/houan/pdf/217/217gaiyou_2.pdf(最後瀏覽日:2025年6月11日)。

[6]STANFORD INSTITUTE FOR HUMAN-CENTERED AI [HAI], Artificial Intelligence Index Report (2024), https://hai.stanford.edu/assets/files/hai_ai-index-report-2024-smaller2.pdf (last visited June 11, 2025)

[7]総務省,〈令和6年版情報通信白書〉,https://www.soumu.go.jp/johotsusintokei/whitepaper/ja/r06/pdf/n1510000.pdf(最後瀏覽日:2025年6月11日)。

[8]総務省,〈令和6年版情報通信白書〉,https://www.soumu.go.jp/johotsusintokei/whitepaper/ja/r06/pdf/n1510000.pdf(最後瀏覽日:2025年6月11日)。

[9]KPMG, Trust Inartificial Intelligence: Country Insights on Shifting Public Perceptions of AI (2023), https://assets.kpmg.com/content/dam/kpmgsites/xx/pdf/2023/09/trust-in-ai-country-insight.pdf.coredownload.inline.pdf (last visited June 11, 2025).

[10]参議院,〈人工知能関連技術の研究開発及び活用の推進に関する法律案に対する附帯決議〉,https://www.sangiin.go.jp/japanese/gianjoho/ketsugi/current/f063_052701.pdf(最後瀏覽日:2025年6月11日)。

隨著加密資產與區塊鏈技術的迅速發展,美國國會眾議院於2025年5月5日提出《數位資產市場結構法案討論稿》(Digital Asset Market Structure Discussion Draft),旨在制定新法並同時修改多部美國聯邦金融法規,以建立數位資產的清晰監管框架,期促進美國數位資產市場創新、投資人保障與維護市場公平,其討論重點如下: 1. 數位資產定義與監管職權劃分:於證券法(Securities Act)與商品交易法(Commodity Exchange Act)新增大量關於數位資產的定義,並明確劃分證券交易委員會(Securities and Exchange Commission, SEC)與商品期貨交易委員會(Commodity Futures Trading Commission, CFTC)的監管界線。 2. 去中心化金融(Decentralized Finance, DeFi)、穩定幣與成熟區塊鏈系統的豁免機制:成熟區塊鏈系統、受核准的支付型穩定幣(Permitted Payment Stablecoins)與特定DeFi活動(如:驗證交易、提供用戶介面等)得排除法令適用,為區塊鏈項目提供更彈性的監管途徑。 3. 市場參與者註冊要求:規定數位商品交易所、經紀商、交易商之市場參與者,應向CFTC註冊之相關要求,遵循包含資本規範、客戶資金隔離、交易監控、報告義務等原則,以提升市場透明度和投資者保護。 4. 數位資產領域研究:要求SEC與CFTC應設立金融創新辦公室(Offices of Financial Innovation) 和創新實驗室(LabCFTC),進行多項關於數位資產領域的研究,包含DeFi、金融市場基礎設施之改善等,以提供監管機構新興技術資訊。

新加坡國會於2020年11月通過個人資料保護法之修正案新加坡通訊暨資訊部(Ministry of Communications and Information, MCI)於2020年11月2日發布新聞稿表示,新加坡國家議會(Parliament of Singapore)通過個人資料保護法(Personal Data Protection Act, PDPA)修正案。主要由新加坡個人資料保護委員會(Personal Data Protection Commission, PDPC)擔任執行與管理機關,而新加坡個人資料保護法僅適用於私人企業、非公務機關。 新加坡通訊暨資訊部特別強調,該個人資料保護法於2013年1月生效,而近年物聯網、人工智慧等新興科技瞬息萬變,隨著資料量急遽增長,企業組織利用個人資料進行創新,成為了社會、經濟和生活的一部分,此次修法意在因應新興科技的進步與新商業模式的發展,使該法可適應、接軌於複雜的數位經濟趨勢,同步維護消費者在數位經濟中的權益,更加符合國際框架,使總部位於新加坡的公司在擴展全球市場時,有助其調整和降低合規成本與風險。主要將加強消費者保護並支持企業業務創新,希望以最大程度提高私部門收益、減少蒐集和利用個人資料的風險,以取得平衡,修訂重點整理如下: 透過組織問責制度,加強消費者之信任; 加強組織使用個人資料開發創新產品,提供個人化服務、提高組織之營運效率; 資料外洩時的強制性通知規定、責任(可參見26A條以下); 提高企業造成資料外洩時的罰款最高額度,當企業組織年營業額超過1000萬美金者,可處以該組織在新加坡年營業額的10%,或100萬新加坡幣(約62萬歐元),以較高者為準(可參見48J條以下); 強化個人資料保護委員會的執法權限,提高執法效率; 為了強化消費者的自主權(consumer autonomy)、對其個資的控制權,規範資料可攜義務(data portability obligation),使個人能要求將其個人資料的副本傳輸到另一個組織(可參見26F條以下); 允許企業在特定合法利益(legitimate interests)、業務改善(business improvement purpose)之目的情況下,對於個資之蒐集、使用、揭露,得例外不經當事人同意,意即不需經當事人事先同意,即可蒐集、利用或揭露消費者個資,例如開發改善產品和進行市場調查研究、在支付系統中進行異常檢測以防止詐欺或洗錢、改善營運效率和服務等目的。(可參見附表一第三、第五部分) 允許關聯企業(related corporations)間,在基於「明確定義相關限制」(clearly defined limits)之相同目的前提下,例如透過具有拘束力的公司規則(binding corporate rules)施以一定限制時,可在彼此內部間蒐集、揭露個人資料。(可參見附表一第四部分) 針對「視為同意」(deemed consent)之相關規定,包含告知後同意(consent by notification)做進一步修訂,將允許企業組織在具契約必要性等特定情形下,在未明確徵得當事人同意之下,向另一個組織或外部承包商(contractors)揭露其個人資料,以利履行契約(fulfil contracts),但該組織與該當事人之間的契約中需有明示條款(express terms)。(可參見15A條以下)

技術進步、資訊流通、隱私保障 澳洲發布「健康隱私指引」以降低健康資料之隱私風險澳洲隱私保護辦公室(Office of the Australian Information Commissioner, OAIC)於2019年9月發布「健康隱私指引」(Guide to health privacy)協助健康服務提供者了解及實踐相關規範所制定之隱私義務以確保個人資料安全。依據1988年澳洲隱私法(Privacy Act 1988)規定,健康服務指所有評估、維持、改善或管理個人健康狀況;或是診斷、治療或紀錄個人疾病或健康狀況之行為。而健康服務提供者除了醫院及醫療人員,更包含其他專業人員例如健身房及減肥診所、私立學校及托兒所、遠端醫療服務等所有涉及健康資料並提供健康服務之單位及人員。由於澳洲隱私法要求服務提供者必須積極建立、實施及維護隱私合法處理程序,為了協助所有健康服務提供者確實遵守法定義務,以減少健康資料之隱私風險問題,OAIC制定「健康隱私指引」提出八大步驟要求健康服務提供者確保遵守義務並保障所持有之個人資料: 制定並實施隱私管理計畫,確保遵守澳洲隱私原則(Australian Privacy Principles, APPs)。 制定明確的責任制以進行隱私管理,並及時提供員工幫助與指導。 建立個人資料檔案紀錄,以確認持有之個人資料。 了解法律規範之隱私義務並實施法定流程以履行義務。 定期舉辦員工隱私培訓課程以強化團隊基礎知識。 建立隱私權政策並於網頁上呈現或是提供手冊說明相關內容。 保護所持有之資料不被濫用、遺失或未經授權的修改及揭露等。 制定資料外洩因應措施,針對資料外洩進行危機處理。