歐洲央行發表「虛擬貨幣架構」報告,法國比特幣交易平台取得PSP資格。

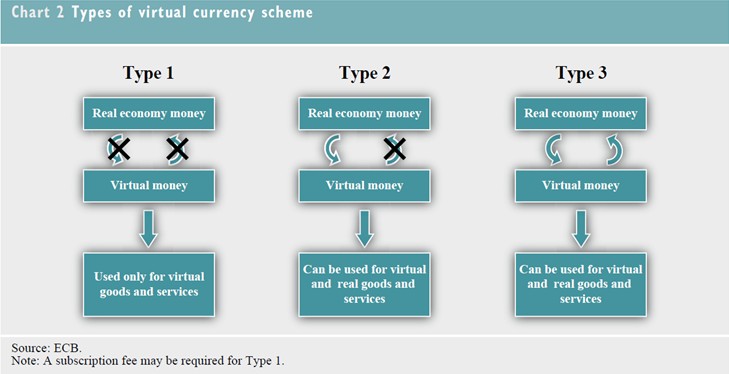

歐洲央行(European Central Bank,簡稱ECB)於2012年10月29日提出「虛擬貨幣架構(Virtual Currency Schemes)」報告(全文可至歐洲央行網站下載,下載網址: http://www.ecb.int/pub/pdf/other/virtualcurrencyschemes201210en.pdf),Bitcoin(中譯「比特幣」)為該報告的研究重點。該報告將虛擬貨幣架構分為三類:1. 封閉性虛擬貨幣架構,與實體經濟幾乎無連結,通常用於遊戲中,例如暴雪娛樂(Blizzard Entertainment)的魔獸金幣(World of Warcraft Gold, WoW Gold);2.單向貨幣流(通常是流入) 的虛擬貨幣架構,可以現金依照匯率兌為虛擬貨幣後用於購買虛擬商品或服務,少數例外可使用於購買實體商品或服務,這類型代表如臉書的FB幣;3. 雙向貨幣流的虛擬貨幣架構,類如其他一般貨幣,具有買進賣出匯率,可支應虛擬以及實體商品、服務的買賣,如比特幣。基於本身特性,比特幣並非歐盟電子貨幣指令(Electronic Money Directive, 2009/110/EC)以及歐盟支付服務指令(Payment Service Directive,簡稱PSD,Directive 2007/64/EC)的適用範圍。目前虛擬貨幣欠缺與實體經濟的聯結,交易量小且欠缺廣泛的使用接受度,因此對於金融以及物價的穩定影響有限;另外,虛擬貨幣欠缺妥適的法規管制,可能被用於不法活動,如犯罪、洗錢、詐欺等等;綜上,若任由虛擬貨幣持續發展而不管制,將被視為是中央銀行的失職而影響其聲譽。然而,報告指出,基於下述原因,虛擬貨幣將有可能繼續蓬勃發展:1. 網路以及虛擬社群使用人的持續增加;2. 電子商務以及特定數位產品的發展,提供虛擬貨幣架構良好的發展平台;3. 相較於其它電子支付產品,虛擬貨幣具備較佳匿名性;4. 相較於傳統支付工具,虛擬貨幣具備較低交易成本;5. 提供虛擬社群所需要的較直接以及快速的交易清算特性。

比特幣出現於2009年,透過數理運算的「挖礦(mining)」技術產生,無發行人,屬於點對點(peer to peer)虛擬貨幣,可匿名持有交易。目前一枚比特幣約當13塊美金,大約新台幣390元,可用於國際部落格平台Word Press,美國紐約、舊金山的部份實體商店也接受比特幣付費。基於比特幣本身的設計,比特幣的流通數量有限,市面上目前流通的比特幣約有1050萬個,預估至2014年將可全數開鑿完畢。全世界最大的比特幣交易所為東京的Mt.Gox,市占率超過80%,支援美金、英鎊、歐元、加幣、澳幣、日圓以及波蘭幣。2011年時,法國法院在Macaraja v. CIC Bank一案指出,點對點比特幣交換為支付服務,在法國應取得PSP執照。

由法國軟體公司Paymium所建置的比特幣交易平台Bitcoin-Central,於2012年12月與取得PSD支付服務提供者(Payment Service Provider,簡稱PSP)執照的法國業者Aqoba結盟,因而取得PSP資格。依照PSD附件說明,所謂的支付服務,包含存款、提款、轉帳、匯款以及第三方支付服務。透過PSP,Bitcoin-Central在歐盟法制架構下取得與Paypal相同的地位,與銀行業者的重大差別只在於Bitcoin-Central無法提供貸款服務。

Bitcoin-Central提供簡易的比特幣交易界面服務,甚至還有手機錢包(mobile wallet),消費者只消在Bitcoin-Central註冊就可以儲值、購買、交易比特幣並將比特幣轉換為現金,也可以當成薪資帳戶直接存入薪資,未來Bitcoin-Central可發行Debit-Card提供刷卡消費的功能。目前Bitcoin-Central只支援比特幣與歐元的轉換服務,而不提供其他幣別的轉換服務。Bitcoin-Central透過PSP業者Aqoba持有服務使用人儲值之歐元款項,款項存放於法國銀行Credit Mutuel,與Paymium的自有款項切割管理。上述歐元款項受有與一般銀行存款相同的法國中央存款保險"Garantine des dépôts”保障,但是比特幣款項由於並不存放於銀行,因此並不受存款保險保障。

比特幣最常被詬病之處在於其常被用於洗錢以及毒品買賣等等犯罪活動,但是支持者指出,現金不也是有相同問題嗎? 現金的洗錢防制透過金融監理的銀行監管進行,虛擬貨幣之交易平台未來也將是法規管制重點。縱使有部分比特幣支持者反對將比特幣納入法制管理,認為比特幣應該依照其原始設計理念運行,Bitcon-Central與PSP業者Aqoba合作可視為對於ECB之正面回應,為虛擬貨幣法制管理之重要進展。

資料來源:European Central Bank, Virtual Currency Schemes, 15 (2012)

- Rosemary Westwood, Why Bitcoin is the banking industry’s newest, biggest threat_

- Bitcoin-Central backtracks on PSP claims,FINEXTRA, Dec. 7, 2012

- Bitcoin digital currency site to operate like bank in France, CBC NEWS, Dec.7, 2012

- Jemima Kiss, Virtual currency Bitcoin registers with European regulators, THE GUARDIAN,Dec.7, 2012

- davout, Bitcoin-Central, first exchange licensed to operate with a bank, This is Huge, BITCOIN FORUM, Dec.6, 2012

- Jon Matonis, ECB: "Roots Of Bitcoin Can Be Found In The Austrian School Of Economics",FORBES, Nov.03, 2012

日本內閣於2017年6月閣議決定「經濟財政營運與改革基本方針2017」,設定醫藥品項倍增目標,並計畫檢討在2020年9月前達成學名藥使用率80%以上之推動政策。基於上開方針,為實現「安定供應國民優良品質醫藥品」、「醫療費效率化」、「產業競爭力強化」等目的,厚生勞動省於2017年12月22日修訂「醫藥品產業強化綜合戰略~著眼全球展開之新藥研發」,希望日本醫藥品產業能從依賴「長期收載品」之商業模式,轉向具備更高新藥開發能力之結構。 「醫藥品產業強化綜合戰略」主要修訂內容如下︰(1)改善日本技術、相關知識等研究開發環境︰如推動癌症基因醫療、資料庫整備、利用AI進行醫藥品研究開發等;(2)透過藥事規制改革減低醫療成本和提高效率︰如善用附條件認可制度,以及先驅審查制度之制度化等;(3)醫藥品生產、製造等基礎設施之整備︰如制定相應之新技術品質管理等規範;(4)適當評價之環境、平台整備︰如各種臨床指引之整備;(5)向海外推廣日本製造之醫藥品︰如制定國際法規調適戰略等;(6)促進新藥開發業界之新陳代謝和全球化創新企業︰支援新創企業之人才育成、金融市場之整備等;(7)改善醫療用醫藥品之流通︰如制定流通改善指引等。

線上遊戲「Second Life」大筆玩家資料外洩線上遊戲新奇的聲光效果與眾多同儕參與的凝聚感,吸引全球玩家爭先投入此一新興娛樂領域之際,遊戲本身的安全性卻也格外值得重視。知名的線上遊戲「 Second Life 」驚傳個人資料外洩事件,遊戲營運商「 Linden Lab 」 9 月 10 號發布公開聲明,表示「 Second Life 」遊戲伺服器於同月 6 日遭到駭客入侵,總計約有 65 萬名玩家的個人資料遭竊。 廣受全球玩家青睞的多人線上角色扮演遊戲( Massive Multiplayer Online Role Playing Game ; MMORPG )「 Second Life 」採取全然的 3D 介面( three-dimensional ),遊戲當中所有的虛擬物件,包括角色、道具與各式各樣的配件均由個別玩家設計與創造,玩家可在遊戲中從事虛擬土地及建築物的買賣並賺取遊戲虛擬貨幣( Linden Dollars );玩家亦可將遊戲中獲取的虛擬貨幣於真實社會中進行現金交易。 營運商「 Linden Lab 」表示,此次駭客係利用「 Zero-Day Exploit 」技術滲透遊戲伺服器,外洩的個人資料包括了玩家姓名、住址、帳號密碼及其信用卡卡號等。 Linden Lab 除已要求所有的玩家立即更改密碼,並將在遊戲的部落格( blog )中提供新的安全方案。

揭露產品溯源資訊,兼顧防偽、永續!歐盟區塊鏈物流認證計畫進行試點,將於11月發布報告為確認產品供應鏈與物流鏈的真實來源、打擊仿冒品、提升永續資訊透明度以接軌歐盟政策,歐盟智慧財產局(下稱EUIPO)自2023年5月啟動區塊鏈物流認證計畫(下稱EBSI-ELSA),採難以竄改、公開透明的區塊鏈服務基礎設施(European Blockchain Services Infrastructure,下稱EBSI),透過數位簽章(digital signature)、時戳追溯與驗證歐盟進口產品的來源是否為智慧財產權利人。EUIPO 於2024年6月24日宣布EBSI-ELSA已上線8成基礎設施。為加速推動計畫,於2024年9月至11月間,EUIPO以產品鏈的智財權利人(例如鞋類與/或服裝、電氣設備、手錶、醫療設備與/或藥品、香水與/或化妝品、汽車零件與玩具產業別之產品智財權利人)為試點,並將於2024年11月前發布試點最終報告。 透過試點,EUIPO致力於: (1)測試、評估於真實世界之製造與分銷系統中應用數位簽章及物流模組的情況,以作為智財權利人之企業資源規劃(ERP)的一部分。 (2)於產品歷程,測試、評估數位裝運契約(digital shipment contract)及產品數位孿生(Digital Twin)之資訊的接觸權限與品質(access to and quality of information)。如海關人員預計於產品抵運前(pre-arrival)、通關階段(inspection phases)確認產品之真實性。 (3)提供產品生命週期應用EBSI-ELSA之試點最終報告,包含實施過程、結果等相關資料。 EBSI-ELSA計畫認為其符合歐盟之數位政策與循環經濟目標,旨於採取區塊鏈技術向供應商、消費者、海關、市場監管機構等多方揭露更多的產品溯源資料,提升產品透明度,銜接歐盟之數位產品護照(Digital Product Passport, DPP)政策,該政策目的係以數位互通方式揭露歐洲市場之產品生命週期的資訊,如產品材料來源、製程、物流、碳足跡等永續資訊,強化產業的可追溯性、循環性(circularity)及透明度,以協助供應鏈利害關係人、消費者、投資者做出可持續的選擇。而負責執行歐盟資料經濟與網路安全相關政策之歐盟執委會資通訊網絡暨科技總署(DG Connect)於2024年5月所發布之「數位產品護照:基於區塊鏈的看法」報告,亦指出「為確保區塊鏈系統互通性,其IOTA區塊鏈技術框架應能與歐盟內部市場電子交易之電子身分認證及信賴服務規章(EIDAS)及EBSI標準完全接軌(fully align)」。 如我國企業欲強化既有的產品生命週期資料管理機制,可參考資策會科法所創智中心發布之《重要數位資料治理暨管理制度規範(EDGS)》,從數位資料的生成、保護與維護出發,再延伸至存證資訊之取得、維護與驗證之流程化管理機制,協助產業循序增進資料的可追溯性。 本文為資策會科法所創智中心完成之著作,非經同意或授權,不得為轉載、公開播送、公開傳輸、改作或重製等利用行為。 本文同步刊登於TIPS網站(https://www.tips.org.tw)

WhatsApp因違反GDPR遭愛爾蘭資料保護委員會開罰2.25億歐元愛爾蘭資料保護委員會(Data Protection Commission,DPC)於今(2021)年9月宣告WhatsApp Ireland Limited(下稱WhatsApp)違反歐盟一般資料保護規則(General Data Protection Regulation,GDPR)並處以高額裁罰。 DPC自2018年12月起主動調查WhatsApp是否違反GDPR下的透明化義務,包括WhatsApp透過其軟體蒐集用戶與非用戶的個人資料時,是否有依GDPR第12條至第14條提供包括個資處理目的、法律依據等相關資訊,以及該資訊有無符合透明化原則等,其中又以WhatsApp是否提供「如何與其他關係企業(如Facebook)分享個資」之相關資訊為調查重點。 歷經長時間的調查,DPC作為本案領導監管機關(lead supervisory authority),於2020年12月依GDPR第60條提交裁決草案予其他相關監管機關(supervisory authorities concerned)審議。惟DPC與其他相關監管機關就該裁決草案無法達成共識,DPC復於今年6月依GDPR第65條啟動爭議解決程序,而歐洲資料委員會(European Data Protection Board)在同年7月對裁決草案中的疑義做出有拘束力之結論,要求DPC提高草案中擬定的罰鍰金額。 DPC最終在今年9月2日公布正式裁決,認定WhatsApp未依第12條至第14條提供資訊予「非軟體用戶」之資料主體,而「軟體用戶」的部分也僅有41%符合規範,嚴重違反GDPR第5(1)(a)條透明化原則。據此,以母公司Facebook全集團營業額作為裁罰基準,DPC對WhatsApp處2.25億歐元之罰鍰,為GDPR生效以來第二高的裁罰,並限期3個月改善。