WTO判澳洲素面菸品包裝一案勝訴

WTO爭端小組於2018年6月28日裁決澳洲「素面菸品包裝案」(Australia—Tobacco Plain Packaging)由澳洲勝訴,本案歷時長達5年,係由古巴、宏都拉斯、多明尼加共和國及印尼4個WTO成員針對澳洲2011年實施「素面菸品包裝法案」(Plain Packaging Act)向WTO爭端解決機構提出控訴。

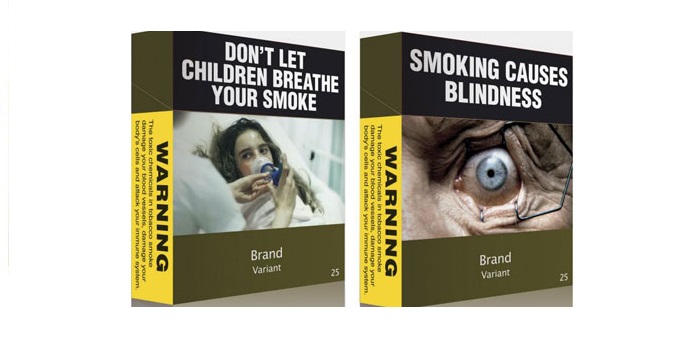

澳洲系爭法案要求菸盒外觀應採統一規格之外觀,禁止使用具識別性鮮明的顏色,不得出現任何具有宣傳效果之商標或印記,僅能以單調的橄欖色為主色,品牌名稱需以小型標準字體印刷,健康警示圖片需占菸盒面積正面75%,背面90%,以達降低國內吸菸人口、保護國民健康之目的。

原告方認為法案侵害菸商使用商標權利,能否有效達到減緩菸害之目的仍有疑義,主張該法制造成不必要之貿易障礙。爭端小組檢視原被告主張與證據,認定澳洲法律係透過減少菸品使用、改善公眾健康目的,手段與目的之間具合理關聯性,駁回原告主張其他替代措施具同等效果的訴求、侵犯商標違反智慧財產權的論點。

此案被視為全球公共健康衛生政策與貿易衝突之指標性案件,目前法國、匈牙利、愛爾蘭、紐西蘭、挪威、斯洛維尼亞、英國均已通過此類包裝規定,而比利時、加拿大、哥倫比亞、印度、巴拿馬、土耳其、新加坡與馬來西亞等國亦有意比照辦理。惟國際菸草產業質疑此項裁定,將使其他欲實施嚴格管制菸品、酒類與垃圾食品的國家開先例,不利於商標權保護與發展。

英國資訊專員辦公室(Information Commissioner's Office, ICO)於2019年12月20日發布首宗依據歐盟一般資料保護規則(General Data Protection Regulation, GDPR)之裁罰。 本案源於英國藥物及保健產品管理局(Medicines and Healthcare products Regulatory Agency, MHRA)接獲投訴前往倫敦當地一家名為Doorstep Dispensaree Ltd之連鎖藥局進行藥品違規調查,卻意外發現其後院存放大量敏感個資文件,約五十萬個文件檔案皆未做任何資料檔案保護措施,上面更記載名字、地址、出生日期、NHS號碼、醫療資料及處方籤等患者之個人資料,旋即通報英國資訊專員辦公室展開調查。最終英國資訊專員辦公室以該藥局違反歐盟一般資料保護規則(General Data Protection Regulation, GDPR)第5條1項第f款、第24條第1項及第32條,裁罰275,000英鎊。其裁罰理由如下: 一、隱私政策並不符合要求,如未述明蒐集個人資料之類別,未訂定個資保存期限,當事人告知聲明不完備,無當事人權利行使等。 二、無適當安全維護措施 三、涉及敏感性個資,違法情狀嚴重 四、未積極配合調查 五、影響層面甚深,導致該藥局配合之上百家療養院,近千名當事人個資受損害。 此為英國資訊專員辦公室首宗依據歐盟一般資料保護規則確定裁罰之案例且涉及敏感性個資,有其指標性。除此之外,英國航空與萬豪酒店之個資外洩案亦欲依GDPR進行裁罰,實值持續關注後續發展。

在西班牙下載音樂無罪?!本週西班牙法官判決,認為行為人為私人用途而下載音樂,其行為並非藉以從中獲利,應認其為無罪。 即便,檢察官辦公室及音樂工會呼籲應對此下載音樂並且在郵件及聊天室提供音樂之被告,處以兩年有期徒刑,然而,在此案當中,卻無直接證據證明被告於銷售音樂之過程中獲利。 此判決震驚了音樂工會,如此一來,西班牙一千六百萬的網路使用者將可透過網路交換音樂而不會受到處罰。西班牙唱片工會聯盟 Promusicae 表示,他將對此項判決提起上訴。 由於歐洲不同的法律規定,關於分享檔案的訴訟也會因不同國家而有極大的差異。然而,大多數的歐洲國家傾向對此處以較高的刑罰。就同為歐盟成員的芬蘭而言,上週便有 22 人因為非法分享電影、音樂遊戲及軟體而被處以 427,000 歐元。 至於西班牙此項為個人用途而下載音樂之行為,據其司法院院長指出,則有待立法修正解決。

歐盟發佈關於監督金融業之數據保護準則歐洲數據保護監督組織(European Data Protection Supervipsor,EDPS)發表「關於在歐盟監督金融業之數據保護準則」(Guidelines on Data Protection for Financial Services Regulation),以作為確保歐盟的數據保護規範,將被整合進正在發展中的金融政策與相關規定之實用工具。該準則為金融市場監督機制的一部分,在金融業對個人資料的處理上,特別是透過監控、記錄保留、回報、以及資訊交換這些存有侵犯個人資料和隱私權風險的措施予以規範。 該準則包含10項步驟與建議,旨在協助歐盟後續金融監督政策的制定,其中一些重要的建議如下: (1)應評估資訊之處理是否可能妨礙隱私權。 (2)應為數據的處理建立法律基礎。 (3)評估適當的資訊保留期限並給予正當化依據。 (4)建立個人資料傳輸至歐盟外的正當法律依據。 (5)提供個人資料保護權利的適當保障。 (6)衡量適當的數據安全保護措施。 (7)應為數據處理的監督提供特定之程序。 有鑒於2008年金融危機的影響,該準則透過提供一個能確保個人資料被妥善保護的有效方法,期以重建金融市場的信心。Giovani Buttarelli,作為新任歐洲數據保護監督委員,在一份伴隨準則釋出的聲明稿當中表示:「個人資料的價值已經隨著數位經濟的成長不斷增加,確保各行業的個人資料得以受到保護也益顯重要。歐洲數據保護監督組織(EDPS)計畫對不同行業制定相關保護規範,此準則是第一個發佈的。」

英國BEIS與Ofgem發布「邁向智慧彈性的能源系統」公眾諮詢英國商業、能源和產業策略部(Business, Energy and Industrial Strategy, BEIS)與天然氣與電力市場辦公室(Office of Gas and Electricity Market, Ofgem)於2016年11月10日共同發佈「邁向智慧彈性的能源系統」公眾諮詢,此份文件作為英國致力於建設21世紀能源基礎設施的一部分,BEIS和Ofgem正進行合作確保英國的能源系統能夠應付未來最新的挑戰,並利用創新技術提供工作機會以及更好的服務。智慧彈性的能源系統將為英國消費者和經濟帶來顯著的好處,協助英國更靈活地使用能源,提高整個能源系統的使用效率。 本文件指出,消費者是智慧彈性能源系統發展的核心,該系統可提供消費者選擇並控制如何用電,包括由消費者產生的任何電力及電能。英國政府的基本概念係基於使市場能夠實現價格、質量的競爭,也希望創新的彈性解決方案能夠與更多傳統解決方案相互競爭。 智慧彈性的能源系統能帶給英國的好處包括以下:高效率的發電與調度、降低能源費用、增加消費者選擇、緩解氣候變遷對能源系統的損害、增加需量反應及儲能的應用、促進新興服務的提供、確保能源供應安全、移轉尖峰負載需求、簡化新能源技術整合既有系統的難度、出口低碳能源專業技術及知識服務、搭配天然氣補充間歇性能源之不足、避免關鍵能源基礎設施的不必要或重複的投資、可出口過剩能源至他國、推動能源產業的新商業模式等等。 對本文件的積極回應以及更廣泛的參與將有助於形成2017年春季公布的政策方案,未來該方案將闡明英國政府計劃採取的具體行動,以消除市場障礙、改善價格信號、促進創新、形塑能源系統中各方角色和責任,將英國未來導向更智慧、更靈活的能源系統,以滿足消費者和企業對於現在及未來的能源需求。