世界經濟論壇發布《人工智慧公平性和包容性藍圖》白皮書

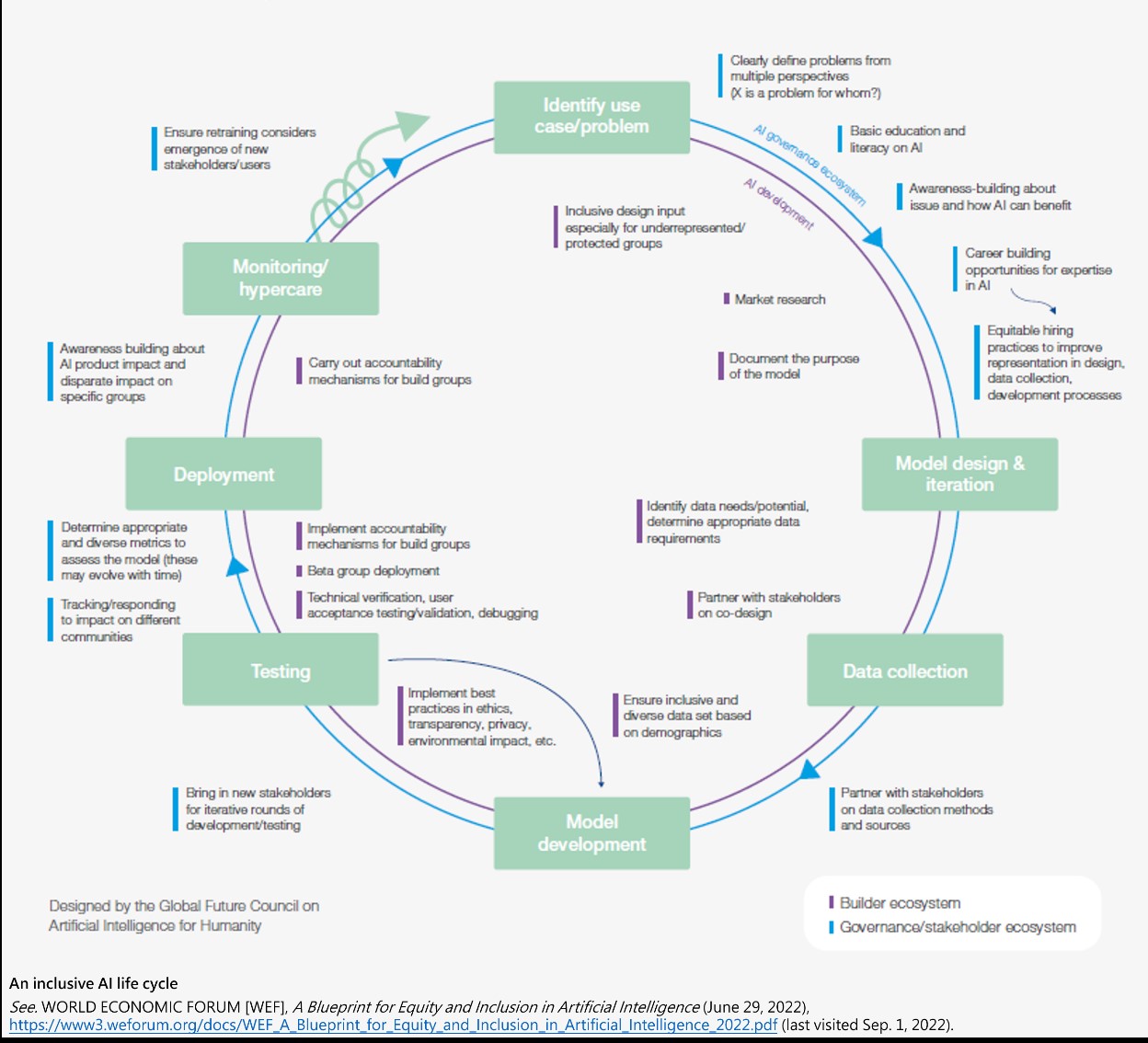

世界經濟論壇(World Economic Forum, WEF)於2022年6月29日發布《人工智慧公平性和包容性藍圖》白皮書(A Blueprint for Equity and Inclusion in Artificial Intelligence),說明在AI開發生命週期和治理生態系統中,應該如何改善公平性和強化包容性。根據全球未來人類AI理事會(Global Future Council on Artificial Intelligence for Humanity)指出,目前AI生命週期應分為兩個部分,一是管理AI使用,二是設計、開發、部署AI以滿足利益相關者需求。

包容性AI不僅是考量技術發展中之公平性與包容性,而是需整體考量並建立包容的AI生態系統,包括(1)包容性AI基礎設施(例如運算能力、資料儲存、網路),鼓勵更多技術或非技術的人員有能力參與到AI相關工作中;(2)建立AI素養、教育及意識,例如從小開始開啟AI相關課程,讓孩子從小即可以從父母的工作、家庭、學校,甚至玩具中學習AI系統對資料和隱私的影響並進行思考,盡可能讓使其互動的人都了解AI之基礎知識,並能夠認識其可能帶來的風險與機會;(3)公平的工作環境,未來各行各業需要越來越多多元化人才,企業需拓寬與AI相關之職位,例如讓非傳統背景人員接受交叉培訓、公私協力建立夥伴關係、提高員工職場歸屬感。

在設計包容性方面,必須考慮不同利益相關者之需求,並從設計者、開發者、監督機關等不同角度觀察。本報告將包容性AI開發及治理整個生命週期分為6個不同階段,期望在生命週期中的每個階段皆考量公平性與包容性:

1.了解問題並確定AI解決方案:釐清為何需要部署AI,並設定希望改善的目標變量(target variable),並透過制定包容性社會參與框架或行為準則,盡可能實現包容性社會參與(特別是代表性不足或受保護的族群)。

2.包容性模型設計:設計時需考慮社會和受影響的利益相關者,並多方考量各種設計決策及運用在不同情況時之公平性、健全性、全面性、可解釋性、準確性及透明度等。

3.包容性資料蒐集:透過設計健全的治理及隱私,確定更具包容性的資料蒐集路徑,以確保所建立之模型能適用到整體社會。

4.公平和包容的模型開發及測試:除多元化開發團隊及資料代表性,組織也應引進不同利益相關者進行迭代開發與測試,並招募測試組進行測試與部署,以確保測試人群能夠代表整體人類。且模型可能隨著時間發展而有變化,需以多元化指標評估與調整。

5.公平地部署受信任的AI系統,並監控社會影響:部署AI系統後仍應持續監控,並持續評估可能出現新的利益相關者或使用者,以降低因環境變化而可能產生的危害。

6.不斷循環發展的生命週期:不應以傳統重複循環過程看待AI生命週期,而是以流動、展開及演變的態度,隨時評估及調整,以因應新的挑戰及需求,透過定期紀錄及審查,隨時重塑包容性AI生態系統。

綜上,本報告以包容性AI生態系統及生命週期概念,期望透過基礎設施、教育與培訓、公平的工作環境等,以因應未來無所不在的AI社會與生活,建立公司、政府、教育機構可以遵循的方向。

- World Economic Forum [WEF], A Blueprint for Equity and Inclusion in Artificial Intelligence (June 29, 2022)

- A Blueprint for Equity and Inclusion in Artificial Intelligence, World Economic Forum (June 29, 2022)

- Global Future Council on Artificial Intelligence for Humanity, World Economic Forum (June 29, 2022)

公共安全和國土安全局(PSHSB)局長傑米.巴尼特(Jamie Barnett)於2011年3月16日與美國聯邦通訊傳播委員會(Federal Communication Commission)分別先後宣示將更近一步加強國家寬頻計畫(The National Broadband Plan)中寬頻通訊科技在公共安全層面的應用。其具體落實在成立國家級的緊急反應互動中心(The Emergency Response Interoperability Center, ERIC)。該中心利用700 MHz頻段成立全國性的公眾安全無線網絡。 促進公共安全無線寬頻通訊的使用,是公共安全和國土安全局最主要的任務。透過建立互動式公共安全寬頻無線技術的操作框架,使警察、消防及緊急醫療人員可使用到最先進的數位式寬頻通訊技術。配備可在任何時間、地點即時傳輸資訊的薄型智慧電話,替代傳統上所使用的對講機。 其次為發展下一代的911通報網絡。目前大約70%的911通話來自手機,可是大多數的911電話通報中心,並沒有配備可接收目前主流行動通訊使用者所傳送的簡訊、電子郵件、視訊或照片的設備。新一代的查詢通知系統(Notice of Inquiry,NOI)可取代傳統的電話,使公眾透過先進的通訊科技獲得緊急救助。雖然精確定位裝置並不在整個系統之中,但通過行動通訊業者所提供的數據,仍可定位需救助者的方位。 美國將寬頻通訊科技落實在公共安全層面的應用,將有助於其提升整體緊急救護的效率。

簡析日本電子帳簿等保存制度與電子資料真實性之確保簡析日本電子帳簿等保存制度與電子資料真實性之確保 資訊工業策進會科技法律研究所 2024年03月29日 日本一般社團法人數位信任協議會於2024年3月15日以數位資料真實性確保的重要性及證明其真實性的時戳技術為題,舉行JDTF電子帳簿保存法解說研討會。研討會中由國稅廳課稅總括課解說電子帳簿保存法上與資料真實性相關的利用者需留意的要點,以及時戳技術的利用意義,並舉出具體的利用者事例作為介紹。 壹、事件摘要 日本電子帳簿等保存制度係指,稅法上等有保存必要的「帳簿」或是「收據、請求書等與國稅相關的文件」,非以紙本方式,而是以電子資料的形式保存的制度,此制度被區分為電子帳簿等保存、掃描保存及電子商業交易資料保存等3種制度[1]。 貳、重點說明 日本電子帳簿保存法於2022年的修法中,廢除電子帳簿等保存制度以及掃描保存制度的承認制度等[2],其中尤其值得關注的是電子商業交易的電子保存義務化。意即,自2022年起個人事業者或法人需要以符合特定要件的方式保存該電子商業交易資料。惟由於日本過往對於所接收的電子商業交易資料均以書面原本的形式進行保存,因此2022年的電子帳簿保存法修正案,雖將所接收的電子商業交易資料以電子資料的形式進行保存作為原則,但是由於許多公司尚無法應對電子資料的保存要求,故日本將2022年1月1日至2023年12月31日的2年間,作為電子商業交易資料保存的宥恕期間,在宥恕期間內無法滿足電子商業交易資料且有正當理由的公司,仍然可以將電子商業交易資料以書面的形式保存,並在稅務調查時將所保存的資料以書面形式提交給稅務機關[3]。日本電子帳簿保存法中所指之宥恕期間,係指自2022年起至2023年12月31日間,無法將電子商業交易資料以電子資料形式進行保存的企業,在符合特定之條件下,使其得繼續維持書面資料保存的期間。須留意宥恕期間僅有2年,公司或法人須於宥恕期間的2年內建立可以符合電子資料保存要件的環境整備。以下就2024年實施的日本電子帳簿3種制度進行說明。 一、電子帳簿等保存制度 對於自身最初透過電腦等製作的帳簿如會計軟體製作的入出帳等,或是與國稅相關的資料如透過電腦製作的請求書、決算書等,在符合具備系統相關資料如系統概要書或操作說明書、在保存場所具備電腦、程式、螢幕、印表機及其操作指南,並將記錄事項以畫面或書面的形式呈現,使其可以快速輸出,以及可以應對稅務職員基於質問檢查權的電子資料下載要求等的要件下,可以不以書面列印紙本的方式,而係以數位資料的形式保存的制度[4][5]。 二、掃描保存制度 決算相關資料以外的國稅相關資料,在符合輸入期間的限制、時戳的付與、版本管理、具備可讀取的裝置、可以快速輸出、具備系統概要書等,以及確保檢索機能等的要件下,能以手機或掃描機器掃描的電子資料形式取代該資料書面原本進行保存[6][7]。 三、電子商業交易資料保存制度 被課與所得稅申告或法人稅等帳簿、資料保存義務者,在處理訂單、契約書、收據、報價單、請求書等或與其相當的電子資料時,在確保真實性及可視性的要件下,需要保存該電子商業交易資料[8]。 電子商業交易資料保存制度中的確保真實性要件包含接收已付與時戳的資料、對所保存的資料付與時戳、不論是資料的接收還是保存,皆已可留存訂正刪除履歷或無法進行訂正刪除的系統進行,以及制定關於防止不正當訂正刪除的事務處理規則並依循。可視性要件則包含具備監控、操作說明書等資料以及具備充足的資料檢索要件[9]。 日本電子帳簿等保存制度雖區分為3種不同的制度,惟其中對個人事業者及法人具有強制效力的僅有電子商業交易資料保存制度,電子帳簿等保存制度及掃瞄保存制度則係設置誘因機制促使業者遵循,如電子帳簿等保存制度中創設其所保存的帳簿如符合訂正刪除履歷留存等「優良電子帳簿」的要件,則可減輕過少申告加算稅的稅金[10];掃描保存制度則讓企業可以透過手機或掃描機器將資料原本掃描成電子資料並以之取代書面紙本進行保存,減少企業保存書面資料的空間成本,同時亦可減低資料檢索時所需花費的時間與人力成本。 參、事件評析 日本電子帳簿保存法中對個人事業者與法人在保存電子商業交易資料時,課以確保電子資料真實性以及可視性的義務,並透過時戳技術的利用,確保個人事業者與法人可以達成電子資料真實性以及可視性的要求。 對於電子資料真實性的管理,我國資訊工業策進會科技法律研究所創意智財中心於2021年發布重要數位資料治理暨管理制度規範(下稱EDGS),協助企業管理內部重要數位資料。EDGS中亦肯認應保存電子資料的訂正刪除歷程,並以時戳技術及存證技術確保資料未經變更、刪除及竄改之真實性。我國企業如欲對自身的數位資料進行管理及存證等,可參考資訊工業策進會科技法律研究所創意智財中心所發布之EDGS建立資料管理流程,以降低數位資料管理相關風險。 本文同步刊登於TIPS網站(https://www.tips.org.tw) [1]国税庁,〈電子帳簿保存法の内容が改正されました〜 令和5年度税制改正による電子帳簿等保存制度の見直しの概要 〜〉,頁1(2023年),https://www.nta.go.jp/law/joho-zeikaishaku/sonota/jirei/pdf/0023003-082.pdf(最後閱覽日:2024/03/26)。 [2]〈税務手続の電子化に関する資料〉,財務省,https://www.mof.go.jp/tax_policy/summary/tins/i04.htm(最後閱覽日:2024/03/26)。 [3]国税庁,〈電子帳簿保存法一問一答【電子取引関係】〉,頁35(2022),https://www.nta.go.jp/law/joho-zeikaishaku/sonota/jirei/pdf/0021006-031_03.pdf(最後閱覽日:2024/03/26)。 [4]同註1。 [5]国税庁,〈はじめませんか、帳簿・書類のデータ保存(電子帳簿等保存)〉,頁1-2(2023),https://www.nta.go.jp/law/joho-zeikaishaku/sonota/jirei/tokusetsu/pdf/0023006-085_02.pdf(最後閱覽日:2024/03/26)。 [6]同註1。 [7]国税庁,〈はじめませんか、書類のスキャナ保存〉,頁1-2(2023),https://www.nta.go.jp/law/joho-zeikaishaku/sonota/jirei/tokusetsu/pdf/0023006-085_03.pdf(最後閱覽日:2024/03/26)。 [8]同註1。 [9]同註3,頁8。 [10]同註5,頁2。

美國「2009年經濟復甦暨再投資法」大幅度修正HIPAA隱私權條款2009年02月17日美國總統簽署通過「2009年經濟復甦暨再投資法」(America Recovery and Reinvestment Act, ARRA),將醫療產業列為重點發展項目之ㄧ,擬由政府預算進行醫療資訊科技化計畫,俾使電子病歷的傳輸與交換得兼顧效率及安全。而以規範醫療資訊安全為主的「醫療保險可攜及責任法」之隱私權條款(HIPAA, Privacy Rule),亦因此有重大修正。 其中,最主要的變革在於擴充HIPAA的責任主體,由原有的健康照護業者、健康計畫業者及健康照護資訊交換業者,擴充至凡因業務關係而可能接觸個人健康資訊的個人或業者,包含藥劑給付管理公司、代理人及保險業者等,這些機構或個人原本與醫療院所或病患間係依據契約關係進行責任規範,但被納入HIPAA的責任主體範圍後,則需依此負擔民、刑事責任。 而於加強資訊自主權部份,亦有數個重要變革如下:(一)責任主體之通知義務:依據新規定,資料未經授權被取得、使用或揭露,或有受侵害之虞時,責任主體應即早以適切管道通知資訊主體有關被害之情事,以防備後續可能發生的損害。(二)資訊主體之紀錄調閱權:以往資料保管單位得拒絕個人調閱健康資料運用紀錄之請求,有鑒於病歷電子化後,保存及揭露相關紀錄已不會造成過重負擔;依據新規定,資訊主體有權調閱近三年內個人健康資料被使用次數及目的等紀錄。(三)資訊主體資料揭露之拒絕權:以往責任主體得逕行提供個人醫療資訊作為治療、計費及照護相關目的之使用,無論資訊主體曾表達拒絕之意與否;依據新規定,資訊主體得禁止其向保險人揭露相關資訊,除非保險人已全額支付醫療費用。 以上HIPAA之新增規範,預計於2010年02月17日正式施行。

美國為加強聯邦補助生物科研之安全性而提出新規範