世界經濟論壇發布《人工智慧公平性和包容性藍圖》白皮書

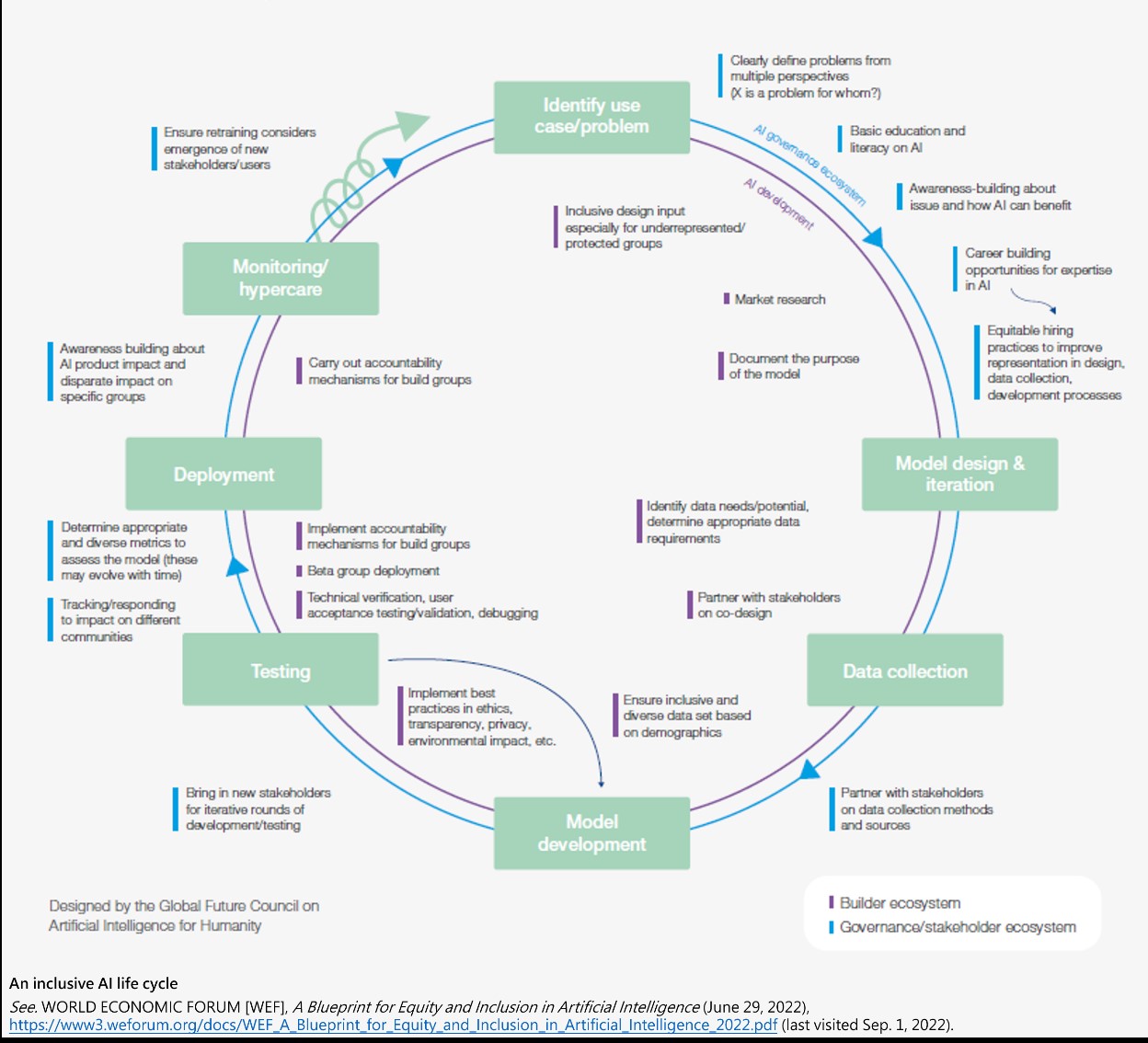

世界經濟論壇(World Economic Forum, WEF)於2022年6月29日發布《人工智慧公平性和包容性藍圖》白皮書(A Blueprint for Equity and Inclusion in Artificial Intelligence),說明在AI開發生命週期和治理生態系統中,應該如何改善公平性和強化包容性。根據全球未來人類AI理事會(Global Future Council on Artificial Intelligence for Humanity)指出,目前AI生命週期應分為兩個部分,一是管理AI使用,二是設計、開發、部署AI以滿足利益相關者需求。

包容性AI不僅是考量技術發展中之公平性與包容性,而是需整體考量並建立包容的AI生態系統,包括(1)包容性AI基礎設施(例如運算能力、資料儲存、網路),鼓勵更多技術或非技術的人員有能力參與到AI相關工作中;(2)建立AI素養、教育及意識,例如從小開始開啟AI相關課程,讓孩子從小即可以從父母的工作、家庭、學校,甚至玩具中學習AI系統對資料和隱私的影響並進行思考,盡可能讓使其互動的人都了解AI之基礎知識,並能夠認識其可能帶來的風險與機會;(3)公平的工作環境,未來各行各業需要越來越多多元化人才,企業需拓寬與AI相關之職位,例如讓非傳統背景人員接受交叉培訓、公私協力建立夥伴關係、提高員工職場歸屬感。

在設計包容性方面,必須考慮不同利益相關者之需求,並從設計者、開發者、監督機關等不同角度觀察。本報告將包容性AI開發及治理整個生命週期分為6個不同階段,期望在生命週期中的每個階段皆考量公平性與包容性:

1.了解問題並確定AI解決方案:釐清為何需要部署AI,並設定希望改善的目標變量(target variable),並透過制定包容性社會參與框架或行為準則,盡可能實現包容性社會參與(特別是代表性不足或受保護的族群)。

2.包容性模型設計:設計時需考慮社會和受影響的利益相關者,並多方考量各種設計決策及運用在不同情況時之公平性、健全性、全面性、可解釋性、準確性及透明度等。

3.包容性資料蒐集:透過設計健全的治理及隱私,確定更具包容性的資料蒐集路徑,以確保所建立之模型能適用到整體社會。

4.公平和包容的模型開發及測試:除多元化開發團隊及資料代表性,組織也應引進不同利益相關者進行迭代開發與測試,並招募測試組進行測試與部署,以確保測試人群能夠代表整體人類。且模型可能隨著時間發展而有變化,需以多元化指標評估與調整。

5.公平地部署受信任的AI系統,並監控社會影響:部署AI系統後仍應持續監控,並持續評估可能出現新的利益相關者或使用者,以降低因環境變化而可能產生的危害。

6.不斷循環發展的生命週期:不應以傳統重複循環過程看待AI生命週期,而是以流動、展開及演變的態度,隨時評估及調整,以因應新的挑戰及需求,透過定期紀錄及審查,隨時重塑包容性AI生態系統。

綜上,本報告以包容性AI生態系統及生命週期概念,期望透過基礎設施、教育與培訓、公平的工作環境等,以因應未來無所不在的AI社會與生活,建立公司、政府、教育機構可以遵循的方向。

- World Economic Forum [WEF], A Blueprint for Equity and Inclusion in Artificial Intelligence (June 29, 2022)

- A Blueprint for Equity and Inclusion in Artificial Intelligence, World Economic Forum (June 29, 2022)

- Global Future Council on Artificial Intelligence for Humanity, World Economic Forum (June 29, 2022)

英國通訊管理局Ofcom近日(2008/12/5)對於英國電信(British Telecommunications, BT)的網路部門Openreach,針對全迴路(fully unbundled line)、分享式迴路(Shared unbundled line)、住宅批發線路出租(Residential wholesale line rental)、商用批發線路出租(Business wholesale line rental)等等接取服務的批發價格提出諮詢文件。 Openreach是Ofcom基於管制需求要求BT所單獨成立的一個網路部門,主要業務為批發電信服務給通信供應商。自2006年成立後至今,原細分化出租之電路線路從123,000 條提升到超過五百萬條,透過批發接取服務的競爭,直接刺激零售電信服務市場的競爭,使消費者有更多的服務選擇以及更物有所值。 除了諮詢批發價格之外,Ofcom在該文件中提及對Openreach的批發服務設立價格上限。之前的批發價格並不包含因每年的通貨膨脹率所進行的調整或修改,在本次文件中則認為通貨膨脹確實會影響Openreach的成本,現在則應如實的反映這樣的調動。Ofcom認為,新的價格將可帶來持續性的寬頻及語音市場競爭,且可以確保Openreach有適當的誘因繼續投資新的建設。 Ofcom在諮詢文件中對於2009年10月後的年度批發價格:全迴路:85.00英鎊 ~ 91.00英鎊(目前是81.69英鎊);分享式迴路:15.60英鎊 ~ 16.20 (目前是15.60英鎊);商用批發線路出租:106.00 ~ 110.00英鎊(110英鎊);住宅批發線路出租:100.68英鎊 ~ 104.40英鎊(目前是100.68英鎊);而其他相關費用調整,依據其成本適時增加。 在諮詢各界意見後,Ofcom預計在2009年4月確定新的批發價格。

英國智財局發布2020-21創新與成長報告,強化智財環境打造創新國家英國智慧財產局(UK Intellectual Property Office)於2021年9月28日發布「2020-21創新與成長報告」(Innovation and growth report 2020-21)。本報告為英國智慧財產局對其2020至2021年間施政工作的總結報告,以創新為帶動國家與企業成長的核心,並期許能透過串接創新者與市場來帶動價值創造,從而建設英國成為全世界最具創新力與創造力的國家。 本報告指出,英國在全球創新指標當中均名列前茅,關鍵在於以系統化、組織化的方式推動創新,從而使創新成為帶動國家發展的動力,並得以對抗冠狀病毒的侵襲與實現淨零(Net Zero)排放的目標。呼應英國在2020年發表研發路徑圖(R&D Roadmap)以及2021年7月發布的創新戰略(Innovation Strategy),英國目標在2035年成為全球創新中心。 面對2020年英國脫離歐盟的巨大轉變,英國智慧財產局同步推動「單一智慧財產局轉型計畫」(One IPO Transformation Programme),以組織重塑、流程再造及數位轉型等方式,完成包含透過政府數位服務系統(Government Digital Service, GDS)推動智慧財產權管理數位化、開發基於人工智慧的商標搜索工具以協助商標申請人降低檢索成本,以及優化包含會計系統在內等工作流程以支持電腦設備更新並提升作業效率等措施。 為了打造世界一流的智慧財產權環境,英國透過一系列政策與法規來鼓勵創新活動,除了面對脫歐過渡期確保對英國商標跟設計等智慧財產權能在脫歐後繼續受歐盟法規的保護,還有藉由與歐洲經濟區以及其他國家的雙邊或多邊貿易協定,納入智慧財產權條款(包含智財保護與執法)、對創新活動的支持、排除與智財相關之市場准入障礙(IP-related market access barrier)、保障消費者選擇,以及獎勵創作人跟補助產業創新等措施,支持英國企業在國內外的創新與成長。

歐盟有機農民團體反對為新植物育種技術(NPBT)訂定新法歐洲法院(European Court of Justice, ECJ)於2018年7月作出裁定,利用新植物育種技術(New Plant Breeding Techniques , NPBT)誘變(mutagenesis)所得之作物亦屬於基因改造生物(genetically modified organism , GMO),因此須適用歐盟的基因改造生物管制指令(GMO Directive 2001/18/EC)。 對於不涉及外源基因添加的新植物育種技術,是否應視為基因改造生物,並需獨立於添加外源基因之基因改造生物另制定框架,對此引發了強烈的討論,科學界/農民跟環保團體/有機農法之農民之間抱持著相反的態度。 科學界/農民認為,歐洲法院是以近20年前所通過的基因改造生物管制指令所做出的解釋,並未考量該技術進步所造成的差異,其認為新植物育種技術之誘變與自然產生的誘變無實質差異,而需要就新植物育種技術另外進行立法。 歐盟有機農民運動聯盟(IFOAM EU)於2019年7月24日發出聲明,認為若將新植物育種技術排除於歐盟基因改造生物管制指令之適用,將造成有機農業與傳統非基因改造生物之農民無法於農作物生產過程中排除基因改造生物之存在,最終將使得消費者、農民、食品加工者失去選擇非基因改造生物之選擇自由,故樂見歐洲法院之見解。 「本文同步刊登於TIPS網站(https://www.tips.org.tw )」

何謂芬蘭科學院(AOF)?芬蘭科學院(Academy of Finland, AOF)是隸屬於芬蘭教育、科學及文化部的專業研究資助機構,旨在促進芬蘭科學研究的多樣化及國際化,資助前端突破性科學研究,提供科學技術及科學政策的專業知識,並加強科學研究的地位。芬蘭科學院最高決策單位為七人委員會,委員會主席由科學院院長出任。 底下設有:文化與社會、自然科學與工程、健康醫學以及環境與自然資源四個研究委員會。每一委員會設主席一人委員十人,任期三年。行政單位由大約一百位專家組成,主要工作為準備及執行七人委員會及各研究委員會的各項工作與決策,並撰寫科學報告和研究計畫。 其任務包括獎助大學與研究機構內的科學研究工作與團隊、參與多邊研究計畫的規劃與獎助、資助芬蘭研究人員參與國際研究計畫、評估科研計畫的品質及水準,以及科技政策專業諮詢等。研究範圍涵蓋建築、太空研究、細胞生物和心理學到電子和環境科學研究。